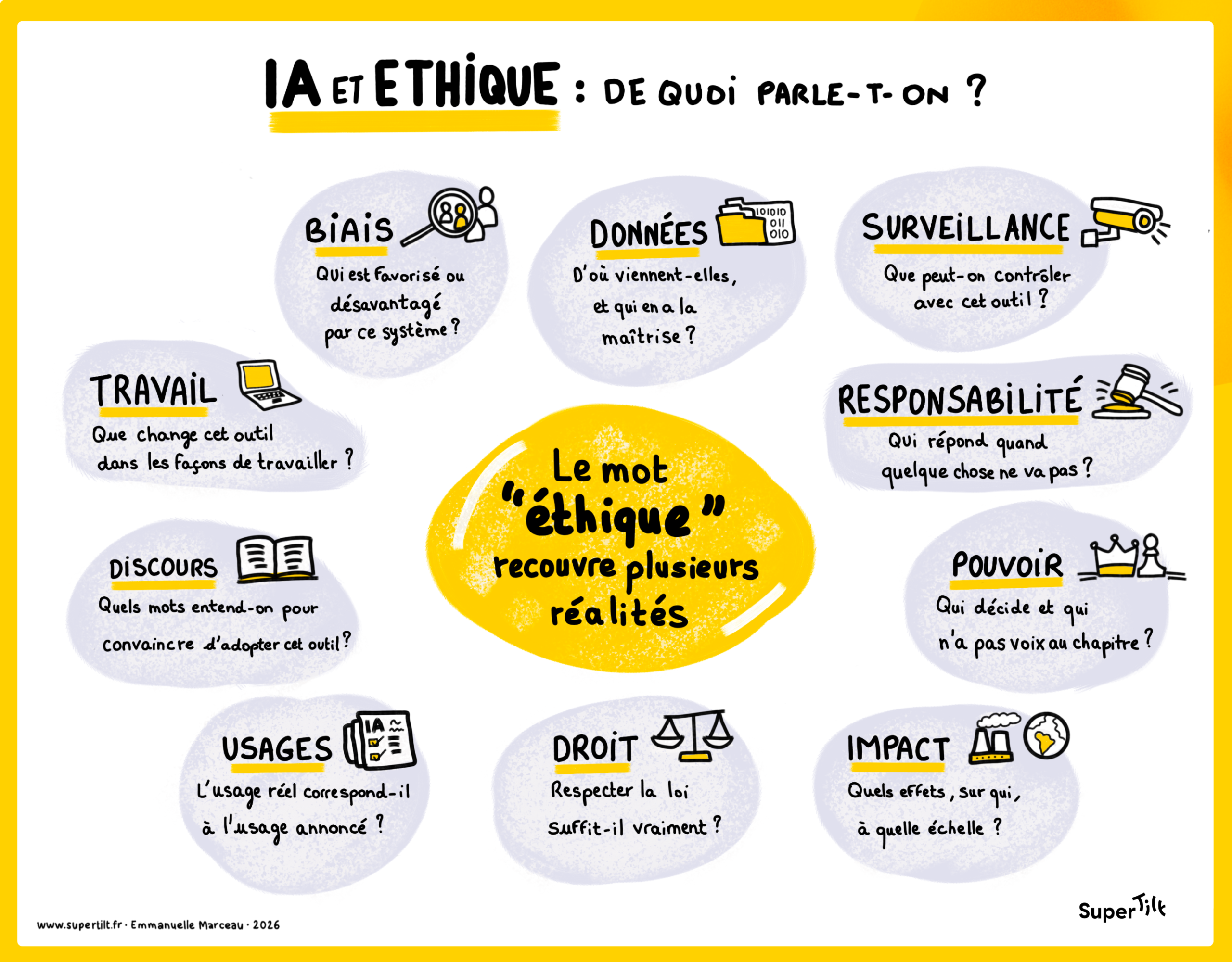

IA et éthique : quand un seul mot recouvre plusieurs réalités

- Publié par Emmanuelle

- le

- Thématique : Intelligence artificielle

Sous le mot “IA“, on range des réalités très différentes. Et sous le mot “éthique“, on met souvent à la fois des principes, des inquiétudes, des arbitrages, des obligations juridiques, et des choix de société. Parler d’éthique de l’IA, c’est accepter de regarder les outils qu’on conçoit, achète ou utilise sous un angle différent : non seulement pour ce qu’ils permettent de faire, mais pour ce qu’ils déplacent en matière de responsabilité, de justice, de confiance ou de pouvoir d’agir. Mais qu’est-ce que l’éthique ?

L’éthique peut se comprendre comme une analyse des valeurs qui orientent nos choix dans des contextes spécifiques : qui décide, au nom de quoi, et avec quelles conséquences pour qui. Quand on parle d’éthique de l’IA, on pense souvent à la question des usages : faut-il l’utiliser ? Jusqu’où ? Avec quelles précautions ? Mais la question éthique commence encore plus en amont :

- dans les données mobilisées,

- dans les choix de conception, dans les critères de performance retenus,

- dans les usages que l’on banalise,

- et dans les récits que l’on construit autour de ces technologies.

Les systèmes d’IA ne tombent pas du ciel. Ils sont entraînés sur des données produites par nos sociétés, conçus par des équipes situées socialement, et diffusés dans des récits qui valorisent la vitesse, la productivité et l’inéluctabilité. L’IA ne fait pas que produire un résultat, elle peut reproduire des inégalités existantes, les amplifier sans qu’on s’en rende compte, ou au contraire les rendre invisibles derrière une apparente de neutralité.

Pourquoi en appelle-t-on à l’éthique à propos de l’IA ?

Parce que les questions qu’elle soulève ne sont pas seulement techniques. Bien sûr, il y a la performance des modèles, la qualité des données, la fiabilité des résultats. Mais dès qu’un système influence une décision, transforme une façon de travailler, ou rend certains choix plus difficiles à comprendre, il touche aussi à autre chose : au sens des décisions, à la place laissée au jugement humain, et aux valeurs que l’on veut protéger dans la société.

Quand des systèmes d’IA gèrent, suggèrent ou décident en partie à notre place, ils peuvent nous faire gagner du temps, de la vitesse ou du confort. Mais ils peuvent aussi nous faire perdre une part de maîtrise sur nos propres activités, tout en rendant la responsabilité plus difficile à porter clairement. À cela s’ajoute le rythme imposé par ces technologies qui peut aller plus vite que notre capacité à comprendre, discuter ou contester ce qu’elles produisent. Et dans certaines activités, l’humain peut avoir le sentiment de passer au second plan en étant relégué au rôle de validation finale, voire d’exécutant. C’est là que l’éthique de l’IA devient intéressante comme une manière de mieux voir ce qui se joue déjà dans les usages du quotidien.

Ethique et IA : un sujet transversal… et instable

Le sujet est d’autant plus difficile à traiter que les effets de l’IA sont transversaux comme l’explique Thierry Ménissier dans le MOOC IA & Société. Ils traversent le travail, l’éducation, la santé, les ressources humaines, les services publics, les médias, la vie démocratique, et bien d’autres domaines encore. On ne parle pas d’un sujet réservé aux ingénieurs ou aux spécialistes du numérique. On parle d’outils et de systèmes qui s’invitent dans des activités très ordinaires.

Les usages se diffusent plus rapidement que les repères partagés pour les discuter. Les textes juridiques avancent, mais ils ne répondent pas à tout. Le droit pose des limites. La technique explique une partie du fonctionnement. Les sciences sociales aident à lire les effets sur les personnes, les organisations et la société. Mais aucune de ces lectures, à elle seule, ne permet de comprendre toute la complexité du sujet.

Un même mot, plusieurs niveaux de questions

Quand on dit IA, parle-t-on d’un modèle, d’une interface, d’un usage métier, d’un cadre réglementaire, d’une promesse marketing, ou d’un imaginaire collectif ? Et quand on dit éthique, parle-t-on de justice, de responsabilité, de transparence, de soutenabilité, de conformité, ou simplement d’un malaise face à ce que certains outils changent déjà dans nos pratiques ?

Même le droit reconnaît cette diversité. Le cadre européen, avec l’AI Act, repose sur une logique de niveaux de risque* et s’applique progressivement selon les systèmes et les usages. Il rappelle que toutes les IA ne se valent pas, et toutes ne soulèvent pas les mêmes questions.

*Quels risques, pour qui, et à quelle échelle ?

On peut distinguer plusieurs niveaux :

- Des risques individuels : atteintes à la vie privée, évaluation automatique peu transparente, décisions automatisées qui affectent un logement, un emploi, un crédit.

- Des risques collectifs : désinformation, manipulation politique, polarisation des opinions, standardisation des comportements.

- Des risques environnementaux : consommation énergétique des modèles, ressources nécessaires aux infrastructures, impact des cycles d’obsolescence.

À partir de là, au lieu de se demander si “l’IA” est éthique ou non, on commence à poser des questions plus précises : de quel usage parle-t-on ? Dans quel contexte ? Pour qui ? Avec quelles conséquences ?

Le droit n’est pas l’éthique (et inversement)

Le droit est indispensable parce qu’il fixe des obligations, des interdictions, des responsabilités minimales. L’AI Act européen en est un bon exemple, tout comme les ressources publiées par la CNIL pour articuler systèmes d’IA et protection des données. La CNIL rappelle notamment que l’usage de l’IA n’échappe pas au RGPD dès lors qu’il implique des données personnelles, et elle a continué à publier en 2025 des recommandations spécifiques pour les acteurs concernés.

L’éthique, elle, intervient ailleurs aussi : dans la question de savoir ce qu’on juge souhaitable, proportionné, contestable, ou défendable dans un certain contexte. Une pratique peut être juridiquement encadrée et rester discutable. À l’inverse, l’existence d’une charte peut donner une impression de sérieux sans créer, en pratique, ni recours, ni audit, ni contradiction possible. Confondre les 2 c’est risquer de réduire la discussion à “est-ce qu’on coche toutes les cases ?”, alors que la vraie question est : “est-ce que nous voulons de ce type de pratique dans notre société ?“

Ethique : les choix importants sont faits avant

On imagine que les questions éthiques arrivent après la technologie, comme une couche de gouvernance qu’on ajouterait une fois l’outil déjà là. Mais beaucoup de choix décisifs sont faits bien avant :

- dans la sélection des données,

- dans la définition du problème à résoudre,

- dans la manière de mesurer la “bonne” performance,

- dans le choix même de déployer ou non un système.

L’exemple d’Amazon est très parlant. L’entreprise avait développé, à partir de 2014, un outil de recrutement entraîné sur des CV historiques. Comme ces données reflétaient un secteur largement masculin, le système a appris à défavoriser certaines candidatures féminines. Le projet a finalement été abandonné. Ce cas est souvent cité parce qu’il montre qu’un système peut produire des effets discriminants sans qu’aucun de ses concepteurs n’ait, a priori, eu l’intention explicite de discriminer.

Quand un système produit un résultat biaisé, ce n’est pas forcément parce qu’il “bugue”. Il peut simplement prolonger des déséquilibres déjà présents dans les données ou dans les pratiques passées. C’est ce qui explique que l’on retrouve des cas documentés dans le recrutement, le crédit, la justice pénale ou la santé.

La vraie difficulté c’est de savoir qui doit corriger quoi. Car un biais technique n’est pas toujours séparé du reste : il peut être le reflet d’inégalités déjà installées dans la société. L’enjeu éthique est donc moins de croire à une IA “neutre” que de rendre les choix visibles, de comprendre leurs effets, et de décider collectivement où l’on place les limites.

"Ce n’est qu’un outil” ? Pas si simple

On entend souvent que l’IA “n’est qu’un outil” et que tout dépend de l’usage qu’on en fait. Ce n’est pas complètement faux mais cette formule est pratique : elle tend à faire peser toute la responsabilité sur l’usager final, alors qu’une partie des effets problématiques se joue bien en amont comme nous venons de le voir.

Dire que tout dépend de l’usage revient à déplacer un problème collectif vers une responsabilité individuelle. Comme si le simple fait de “bien prompter” ou d’être un utilisateur vigilant suffisait à corriger des choix de conception, des asymétries de pouvoir ou des logiques industrielles déjà à l’œuvre. Bien sûr, les usages comptent mais ils ne sont pas toute l’histoire. Une IA n’est jamais simplement “là”. Elle est conçue dans un contexte économique, technique, social et politique. Elle embarque des choix, des arbitrages et des visions du monde, même lorsqu’ils restent peu visibles pour l’utilisateur final.

Quand le mot "éthique" sert d'affichage

Depuis plusieurs années, les chartes et principes éthiques pour l’IA se sont multipliés. L’Union européenne, l’OCDE, l’UNESCO, des dizaines d’entreprises technologiques, des centaines d’organisations ont publié leurs engagements. On y retrouve les mêmes grands mots : la transparence, la justice, la responsabilité, la vie privée. Les mots sont partagés mais les définitions, les mécanismes de contrôle et les sanctions ne le sont pas. “Transparence” pour un chercheur en machine learning (accès au code source, aux données, aux processus de décision) ne signifie pas la même chose que pour un DRH qui doit expliquer à un candidat pourquoi sa candidature a été rejetée.

Ce phénomène a un nom dans la littérature académique : ethics washing ou parfois AI ethics theater. Il désigne la production de discours éthiques qui donnent une apparence de rigueur sans engager de contraintes réelles. Le cas d’ATEAC en est un exemple : lancé en 2019, ce comité a été dissous quelques jours plus tard, après des controverses sur sa composition et un conflit d’intérêts potentiel. Ce cas rappelle qu’afficher une ambition éthique ne suffit pas à rendre une démarche crédible.

Qui parle, et au nom de quoi ?

Le débat sur “l’IA éthique” est façonné par des acteurs qui n’ont pas tous les mêmes intérêts :

- Les grandes entreprises technologiques, qui veulent innover vite, conquérir des marchés, éviter des régulations trop contraignantes.

- Les pouvoirs publics, qui cherchent à la fois à protéger les citoyens, à rester attractifs pour l’innovation, et à ne pas se laisser distancer géopolitiquement.

- Les chercheurs, les ONG, les syndicats, les associations de défense des droits, qui alertent sur les risques et les effets de structure.

- Les médias et le grand public, qui oscillent entre fascination et méfiance.

Dans ce contexte, l’éthique peut devenir un espace de négociation… voire un argument d’affichage. On parle de “responsible AI”, de “confiance”, de “transparence”, sans toujours interroger les modèles économiques, le partage de la valeur ou la concentration du pouvoir. Tant qu’on ne dit pas clairement qui parle, depuis quelle position et avec quels objectifs, on reste facilement dans un débat abstrait.

Parler d’IA et d’éthique, ce n’est donc pas seulement se demander si une technologie est “bonne” ou “mauvaise” en soi. C’est aussi se poser la question de quelles technologies nous voulons mettre au service des projets de société, et dans quelles limites ?

Les dimensions qu’on oublie

Quand on évoque l’éthique de l’IA, certains thèmes reviennent presque automatiquement : les biais, la vie privée, la désinformation. Ce sont des sujets importants mais parmi les autres dimensions importantes (souvent masquées par les promesses offertes), on peut citer :

Le travail humain, derrière l’automatisation

Une partie du coût humain de l’IA reste peu visible, notamment dans les tâches de modération et d’annotation. En 2023, des enquêtes ont mis en lumière les conditions de travailleurs kenyans employés par Sama pour aider à rendre ChatGPT moins toxique, avec une exposition à des contenus extrêmement violents et sexuels, une rémunération faible, et des conséquences psychologiques décrites comme sévères par plusieurs anciens travailleurs.

La surveillance, derrière l'efficacité

En février 2025, la CNIL a annoncé une sanction de 40 000 euros contre une entreprise du secteur immobilier pour une surveillance jugée disproportionnée de ses salariés : logiciel de suivi de l’activité, comptabilisation de périodes supposées d’inactivité, captures d’écran régulières et vidéosurveillance permanente. Là encore, on n’est plus dans un débat abstrait sur “l’IA en général”, mais dans une situation de travail bien réelle, avec des effets très concrets sur les personnes.

Le perte du jugement derrière le gain de temps

Les outils d’IA générative se diffusent désormais dans notre quotidien professionnel. Un outil de rédaction assistée peut faire gagner du temps, mais aussi lisser la pensée. Un assistant de synthèse peut alléger la charge de travail, mais aussi installer une dépendance cognitive si plus personne ne relit vraiment. Un outil RH peut sembler plus “objectif”, tout en rendant moins visible l’origine des critères utilisés.

Une étude menée par Microsoft et Carnegie Mellon en 2024 auprès de 319 professionnels utilisant des outils IA au quotidien a mis en évidence un effet paradoxal : plus les personnes faisaient confiance à l’outil, moins elles exerçaient leur propre jugement critique, y compris quand l’outil produisait des erreurs. Le gain de temps peut s’accompagner d’une perte progressive de la capacité à vérifier ce qu’on délègue.

Ces trois dimensions partagent un point commun : elles sont rarement visibles dans les chartes éthiques ou les discours de principe. Elles n’apparaissent qu’une fois les outils déployés, dans le quotidien des personnes qui en vivent les effets sans avoir eu voix au chapitre.

Aucun usage du quotidien n'est neutre

Sans vouloir dramatiser chaque usage, la question est plutôt de reconnaître qu’aucun usage n’est totalement neutre. Il y a toujours quelque chose qui se déplace : du temps, de l’attention, du pouvoir d’agir, de la responsabilité, de la capacité de contestation, ou de la compréhension de ce qui se passe réellement.

C’est aussi pour cela que certaines approches venues du terrain du travail me paraissent plus utiles que les grandes déclarations. L’Anact parle aujourd’hui de “dialogue social technologique” pour désigner les discussions et négociations autour des transformations numériques du travail, y compris celles liées à l’IA. Cette approche me semble intéressante, parce qu’elle remet autour de la table les personnes qui conçoivent, celles qui décident, et celles qui vivent les effets des outils au quotidien.

Les récits autour de l’IA font aussi partie du problème

Nos imaginaires influencent notre manière de comprendre les technologies parfois sans qu’on s’en rende compte. On ne parle pas de l’IA uniquement à partir de ses usages réels. On en parle aussi à travers des récits. Ceux de la science-fiction : machines qui se rebellent, IA omnisciente et toute-puissante. Ceux du solutionnisme technologique : l’IA va régler la pénurie de professeurs, la crise climatique, les inégalités…. Ceux du catastrophisme : l’IA va détruire tous les emplois, rendre l’humain inutile, etc..

Ces récits ont un effet :

- Ils poussent à personnifier l’IA comme si la technologie décidait seule.

- Ils masquent les acteurs humains qui conçoivent, déploient, financent et contrôlent les systèmes.

- Et ils peuvent aussi détourner l’attention de problèmes très actuels, comme la surveillance, l’exploitation ou les inégalités.

Ils influencent donc notre manière d’adopter, de tolérer ou de questionner certaines technologies. Ils peuvent produire de la peur, du conformisme, de la précipitation. Ils peuvent aussi rendre plus difficile l’expression du doute, du désaccord ou de la nuance. Et quand une technologie est présentée comme inévitable, désirable par principe et forcément synonyme de progrès, il devient plus difficile de la questionner.

IA & éthique : grille de lecture pratique

1. De quel outil parle-t-on ?

Un logiciel, une fonctionnalité intégrée dans un outil qu’on utilise déjà, un service accessible en ligne ? Qui le fournit, et dans quel intérêt ?

2. Quel modèle est derrière ?

Où vont les données qu’on y saisit ? Peut-on savoir comment il a été entraîné, et par qui ?

3. Quel usage concret ?

À quoi sert-il vraiment au quotidien et vers quoi pourrait-il dériver sans qu’on l’ait décidé explicitement ?

4. Quels risques principaux ?

5. Quel cadre juridique s’applique ?

RGPD, AI Act, droit du travail, réglementation sectorielle, est-on dans le flou ou bien encadré ?

6. Quels imaginaires mobilise-t-on ?

7. Qui décide et qui subit ?

Quels acteurs sont autour de la table, qui bénéficie des gains, qui supporte les risques ?

8. Exemple simple

Prenons un exemple: un assistant IA qui rédige automatiquement les comptes rendus de réunion.

On a un outil branché à la visio ou à la prise de notes, qui transcrit les échanges, résume les points clés et propose un compte rendu prêt à envoyer.

- L’usage : gagner du temps sur la prise de notes et la rédaction du compte rendu.

- Les risques : résumer de travers, oublier des nuances, attribuer une décision à la mauvaise personne, rendre moins visibles les désaccords, ou faire circuler des informations sensibles.

- Le droit : information des participants, traitement de données personnelles, confidentialité des échanges, règles internes de l’organisation.

- L’imaginaire : promesse de neutralité (“le compte rendu est objectif”) et de gain de temps immédiat.

- Les acteurs : l’éditeur de l’outil, l’organisation qui l’achète, les managers qui l’imposent, les salariés dont les paroles sont captées et résumées.

Avec cette grille, on sort du débat : “l’IA pour faire des comptes rendus, pour ou contre ?” pour répondre aux questions : quelles données sont captées, qui valide le résumé, que garde-t-on sous contrôle humain, et dans quelles situations cet outil est-il acceptable ?

Pour conclure

S’il y a un point à retenir, c’est que l’éthique de l’IA ne se joue pas seulement dans de grands principes, elle est aussi dans nos choix : les usages que l’on banalise, les outils que l’on autorise, les données que l’on partage, les explications que l’on demande, et les personnes que l’on associe ou non aux décisions.

On a vu que sous le mot “éthique”, on fait référence à des questions de biais, de droit, de travail, de surveillance, de pouvoir, d’impacts, de récits… Autant de dimensions qui rendent le sujet passionnant et complexe, impossible de le réduire à un simple débat pour / progrès versus contre / méfiance.

Et ça se joue aussi dans le temps car une IA ne se contente pas de produire une réponse ponctuelle : elle influence des comportements, génère de nouvelles données, puis s’appuie à nouveau sur elles. C’est ce que certains chercheurs décrivent comme une forme de coévolution entre humains et systèmes d’IA. Autrement dit, nos usages façonnent les outils, et ces outils, en retour, transforment peu à peu nos façons de travailler, de décider, de nous informer ou d’interagir.

Ce qui me semble intéressant, c’est que cette exigence éthique ne vient pas seulement des experts ou des institutions. Elle monte aussi du terrain. Plus l’IA entre dans le travail réel, plus les attentes deviennent concrètes : protection des données, qualité des décisions, impact sur l’emploi, responsabilités. L’éthique devient une condition pour que les usages restent compréhensibles, discutables et vivables.

Le sujet est de savoir comment traduire le concept d'”IA responsable” dans les faits : dans la formation, dans la gouvernance, dans les règles du jeu, dans les espaces où l’on peut encore questionner les usages et arbitrer collectivement. Car une technologie peut être impressionnante, rapide, utile même, sans que cela suffise à la rendre souhaitable telle quelle.

Dans ce contexte l’éthique consiste peut-être d’abord à ne pas laisser ces évolutions se faire en silence. À poser les bonnes questions, à rendre visibles les choix. Et à garder des espaces où l’on peut encore discuter ensemble de ce que l’on veut faire ou non de ces technologies.

Sources

Voici la liste des ressources utiles sur lesquelles nous nous sommes appuyés pour rédiger cet article.

Articles et rapports

- UNESCO – Recommandation sur l’éthique de l’intelligence artificielle

- Science Direct – Human AI co-evolution

- EU AI Act – Texte officielle (Regulation (EU) 2024/1689)

- Site du Gouverment – Présentation synthétique de l’IA Act

- Livre Blanc “L’IA éthique en pratique” (Hub France IA, 2023) : Guide pratique avec 117 recommandations pour intégrer l’éthique dans le cycle de vie des systèmes IA

- Conseil d’État (2022), Intelligence artificielle et action publique : construire la confiance, servir la performance

- CNIL (2017), Comment permettre à l’Homme de garder la main ? Les enjeux éthiques des algorithmes et de l’intelligence artificielle

- Conseil de l’Europe, IA et discrimination

- Parmi les ressources consultées figure également l’Observatoire de l’IA responsable en entreprise publié pour Impact AI. Cette source est intéressante pour documenter les perceptions et attentes des salariés du privé, mais elle émane d’un écosystème d’acteurs directement impliqués dans le développement et la gouvernance de l’IA en entreprise, ce qui invite à la lire avec recul : https://www.impact-ai.fr/

Ressources complémentaires

- MOOC FUN Intelligence artificielle et Société

- Vidéo – Les robots sont-ils machos ?

- Vidéo – Les dilemmes éthiques de l’IA, Ministère de l’Economie, de l’Innovation et l’Energie, Québec

- Podcast – L’éthique de l’IA avec Martin Gibert

- Podcast – Comment allier IA et éthique ?

L'autrice

Plus d'articles

Découvrez nos formations :

Facilitation graphique

5 modules pour découvrir la pensée visuelle : des exercices, des échanges en live et une communauté soudée !

Sketchnoter sur tablette

Vous pratiquez la pensée visuelle sur papier et vous envisagez de passer au numérique ? Cette formation vous guide pas à pas.

IA4Product

Un bootcamp pour les responsables produit qui veulent améliorer leur quotidien avec l’IA.